近期,,機(jī)械學(xué)位點(diǎn)2023級(jí)碩士研究生燕順在Information Fusion(中科院一區(qū)TOP期刊,,IF:14.7?)上以第一作者的身份發(fā)表題為“Multi-scale convolutional attention frequency-enhanced transformer network for medical image segmentation”的研究性論文,臺(tái)州學(xué)院為唯一單位,。

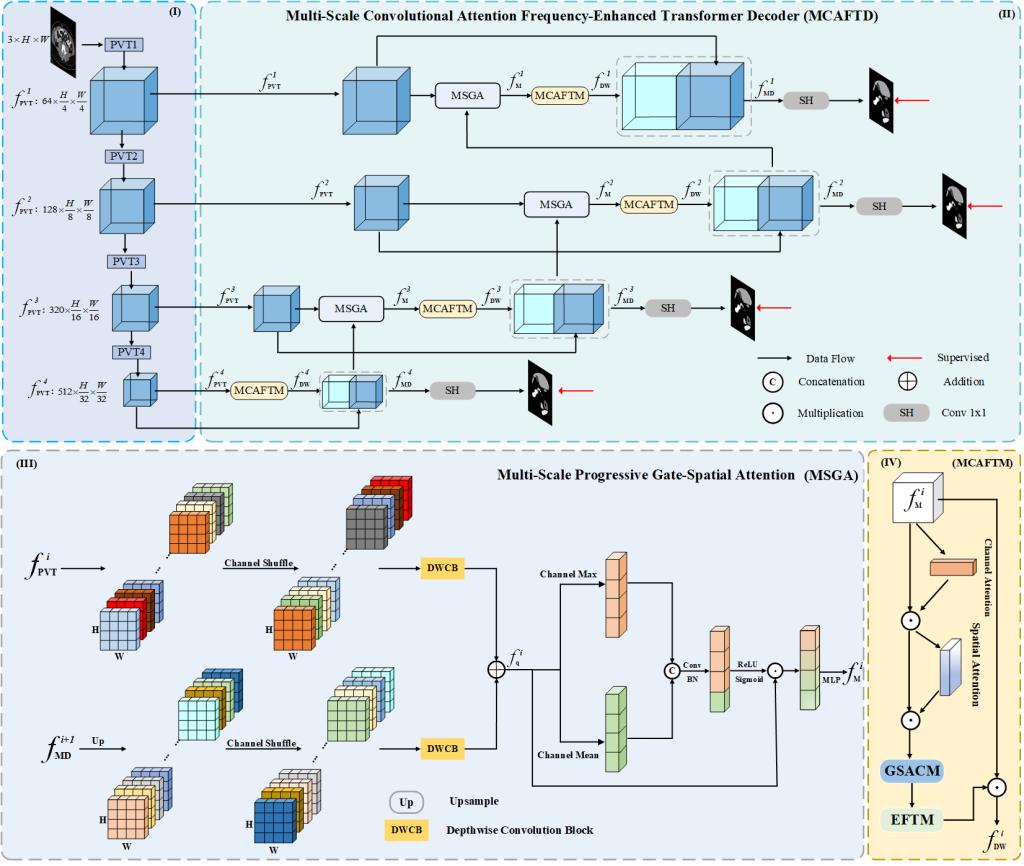

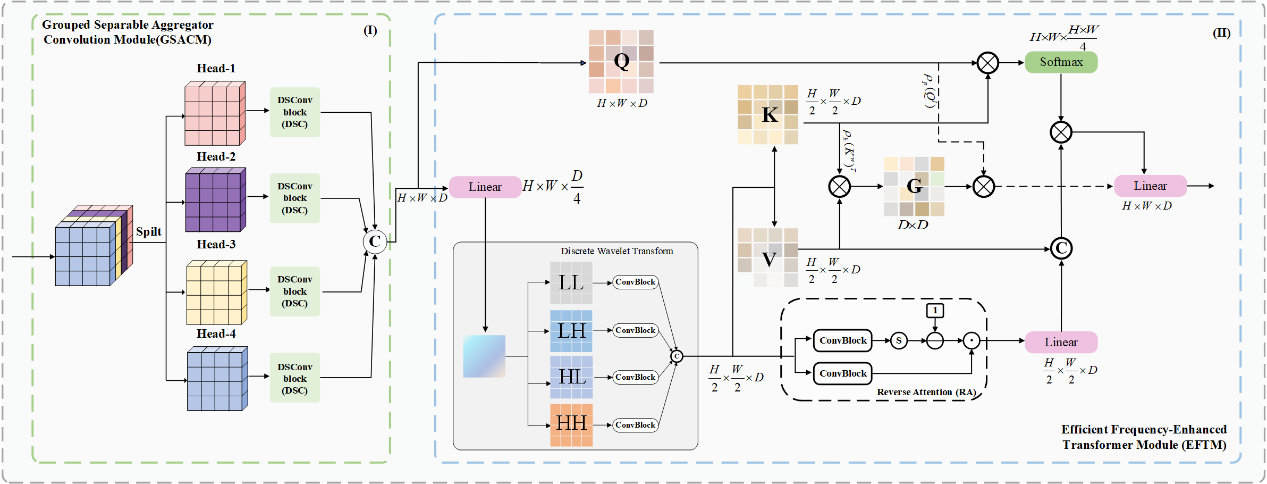

該論文針對(duì)解決傳統(tǒng)Transformer局部特征提取不足以及細(xì)節(jié)信息缺失的缺點(diǎn),,提出了一種結(jié)合小波變換的多尺度卷積注意頻率增強(qiáng)Transformer網(wǎng)絡(luò)。旨在利用小波變換在不同尺度下同時(shí)保留圖像的時(shí)頻特征,,有效捕捉高頻信息,,如紋理和邊緣細(xì)節(jié),以此提高圖像分割的精度,。

圖1 多尺度卷積注意頻率增強(qiáng)Transformer網(wǎng)絡(luò)

圖2 分組可分離聚合卷積模塊(GSACM)和高效頻率增強(qiáng)Transformer模塊(EFTM)

該研究成果提出了可應(yīng)用于疾病診斷,、智能影像分析及智能醫(yī)療等醫(yī)療健康場(chǎng)景的新Transformer網(wǎng)絡(luò)模型,得到國(guó)家自然科學(xué)基金“基于生成對(duì)抗網(wǎng)絡(luò)的融合聽覺和視覺信息的多模態(tài)人格識(shí)別研究項(xiàng)目”的支持,。

論文鏈接:https://doi.org/10.1016/j.inffus.2025.103019